▲在 #MadewithAI 亞太區活動當中,Google 公開多項現有 AI 與機器學習應用,告訴人們 AI 的三大發展方向。(圖/記者洪聖壹攝)

記者洪聖壹/台北報導

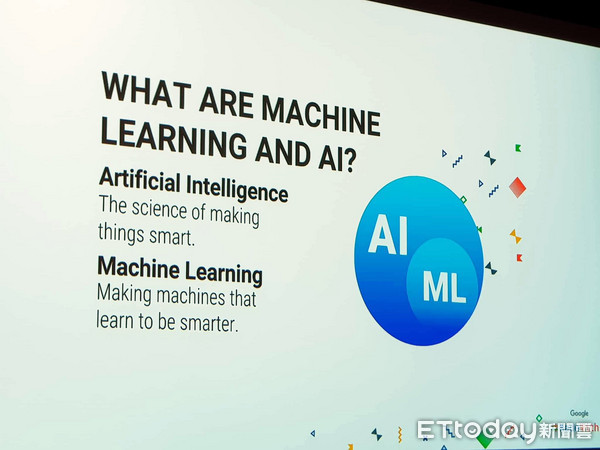

Google 稍早在日本東京總部舉辦 AI Day,與來自來自日、韓、新馬、台、港、澳、中國等 11 個國家、將近 60 間媒體,說明有關Google推展AI的三個方向,強調AI主要在幫助人類解決日常所需,並非用來取代人類。而對所有領域來說,AI 跟機器學習雖然有很大的進展,但一切都只是剛起步而已,唯有人工智慧進入人類生活,才能抓住它改善全人類生活的潛力與機會。

Google 發展 AI 人工智慧已經長達 15 年,不過近期來說,全球人工智慧真正開始積極推展的,主要還是AlphaGo在韓國對上李世石一役,因為圍棋擁有驚人的 10 的 170 次方種可能的棋盤佈局,相較於1997 年打敗棋王 Gary Kasparov 的西洋棋程式 DeepBlue,可謂大幅度進展。

首度抵日的 Google 研究團隊資深研究員 Jeff Dean 在這次的大會中揭示 Google 發展 AI 的三個方向,分別為「貼近人類需求的 Google 產品」、「持續打造創新的服務跟應用」,以及「研究出可解決人類難題的工具」。

▲Google 研究團隊資深研究員 Jeff Dean。(圖/記者洪聖壹攝)

持續打造創新的服務跟應用

Google CEO Sundar Pichai 日前在 Google I/O 期間,曾明確揭示 Google 公司的下個十年將會從 mobile-First 朝向以 AI-First 為核心發展。事實上,像是Android、Chrome、Google Search、Google Play、Gmail、Google Maps、YouTube 等 7 個導入人工智慧的產品,目前已經有超過 10 億用戶。

Jeff Dean 在現場展示了透過機器學習怎麼樣學習貓、狗、汽車、蘋果、花等影像,然後最後辨識出貓。現在透過 Goolge Lens 可以辨識獅子、聲音語調、文字內容,甚至照片,好比說你給他一張火車的照片,系統已經可以清楚辨識,並告訴你這是一輛藍、黃相間車身的火車,目的地是往哪裡。

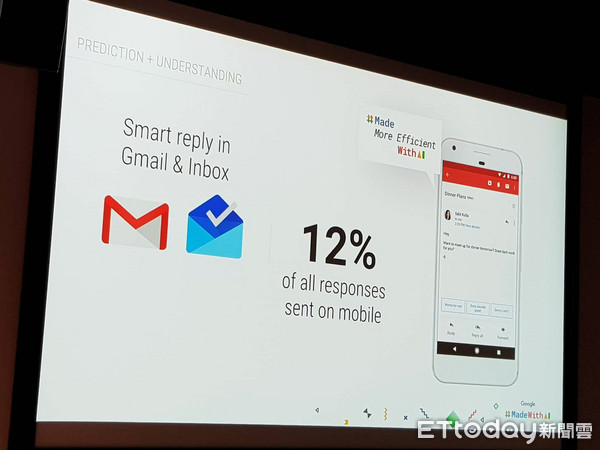

除此之外,還有 Google I/O 2017 期間 Google Lens,可以輕易辨識地點、路邊書本的名字、圖片上的地圖、拍攝美術館,還可以進一步了解美術館正在展覽的內容,而導入機器學習的 Gmail 現在可以成功阻擋 99.9%的垃圾郵件;最新推出的 Google Home 可支援多達 6 個人的語音配對。

其他還有像是 Google Play Music 透過導入 AI 技術能理解用戶喜歡的音樂、然後提供相對應的個性推薦。如果是美國部分城市用戶,使用 Google Maps 還有「停車預測」功能,其背後更集合了群眾回饋以及機器學習技術,建構了一套系統來幫助使用者預測停車位。至於大家幾乎每天使用的 YouTube 平台,透過機器學習為YouTube自動上了超過十億支影片,讓全球三億以上的失聰或聽障朋友也能瞭解影片內容。Google翻譯透過神經機器翻譯系統 (Neural Machine Traslation, NMT),也有效提升翻譯的品質,目前已可支援近97種語言跟英文的互譯,其中包括許多亞太地區的語言...等等。

▲Google Maps 在美國 25 個城市提供停車廠建議功能。(圖/記者洪聖壹攝)

▲▼透過 Google Lens 可以在拍下照片之後,確實了解身邊的事物,或者快速翻譯不熟悉的語言。(圖/記者洪聖壹攝)

▲透過導入機器學習,現在 Gmail 與 Inbox 已經能夠 12% 辨識信件內容,並給予回覆建議。(圖/記者洪聖壹攝)

貼近人類需求的產品

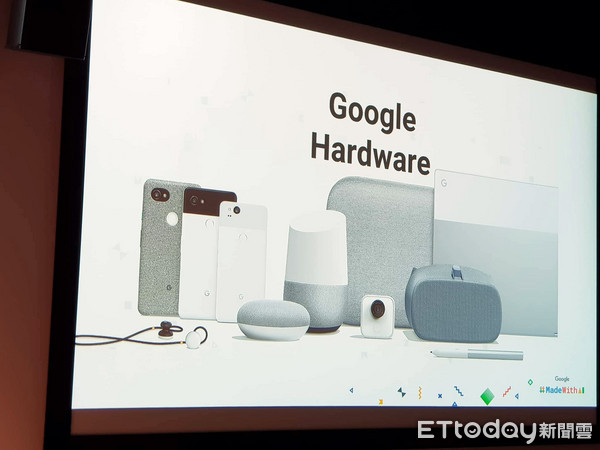

除了軟體之外,這兩年積極搶攻硬體市場的 Google,同樣透過人工智慧進行產品軟硬體整合。負責 Google Pixel 相機開發的產品經理 Isaac Reynolds 表示,透過 Googe Home,家中的所有人(最多同時 6 人)都跟機器對話,而機器可以快速回應各種不同需求,好比說請它設定房間的鬧鐘、問它義大利的時間、要它開啟客廳的電視並播放 Netflix等等,而且可以清楚辨識每個人的聲音,這是深度學習的一環,Google 已經導入超過 1000 個不同的房間位置的聲音模組,現在透過機器學習機制,它能了解每個人的聲音、回應每個人的需求,後續推出的 Google Home Max 是高階的音箱,提供跟 Google Home 一樣的功能,並且更能夠理解人們的所在地點,記者實際拍攝一段 Google Home 實測影片提供給讀者們參考:

▲▼Google HOME 的實際應用很廣,可在居家辨別 6 個不同的家族成員的聲音,並給予即時回應,包括可以在電視還未開啟的前提下,使用「幫我在電視裡秀出我養的狗狗的照片」的指令。(圖、影片/記者洪聖壹攝)

至於 Google Pixel 的人像模式,同樣也是導入機器學習技術,藉由認識環境,以及誰是主體,藉此模擬出景深效果。至於 Pixel 2 人像模式又更進階,除了上述的學習機制,透過兩個不同的 Photodiode,在一個非常小的單鏡頭當中,可以認識環境做出深度地圖,有效區別出人像與背景,接著將「劃分遮罩」和「深度圖」組合成一張優化過的深度圖,然後根據估計的距離決定背景模糊的程度,兩者互相結合起來,做出更自然的人像模式。

▲Google Pixel 相機開發產品經理 Isaac Reynolds。(圖/記者洪聖壹攝)

研究出可解決人類難題的工具

首先談到自然語言學習,Google 人工智慧研究總監 Linne Ha 分享一位名為 Arm 的故事,一名泰國工人透過跟機器對話,轉換成文字之後,成功找到失散多年的家人。目前全球有超過 6000 種語言,當中的 4000 種語言人口只有 100 萬人,如果能夠透過機器學習的技術,讓每個能夠上線的人們都能用自己的語言與其他人交流,將可望創造更多類似 Arm 的故事。

▲Google 人工智慧研究總監 Linne Ha。(圖/記者洪聖壹攝)

除了自然語言,最近這幾年相當火紅的語音助理當中,Google Assistant 應該是近年來最具有人工智慧色彩的語音助理。Google Assistant 工程技術總監 Pra Gupta 表示,一年前推出的 Google Assistant,現在已經在搜尋、Google Maps、Android Wear、Android TV、Google Home 等服務當中都有她的影子,透過 Google Assistant 用戶可以輕易地控制家電、操作 App,而且不用遙控器就可以讓電視透過聲控的方式啟動、選擇影片等等,在 Google I/O 2017 期間,記者實際體驗一輪,提供下方回顧影片給讀者們參考:

▲Google Assistant 可以整合第三方 Apps 然後協助開啟跟回應。(影片/記者洪聖壹攝)

▲內建Google Assistant的 Android TV 可以遠端控制家電。(影片/記者洪聖壹攝)

▲內建Google Assistant的 Android TV 免持操作介紹。(影片/記者洪聖壹攝)

▲內建Google Assistant的 Android Auto 可以遠端控制家電。(影片/記者洪聖壹攝)

▲內建Google Assistant的 Android Wear 介紹。(影片/記者洪聖壹攝)

Pra Gupta 指出,Google Assistant 還在成長當中,目前支援英文、德文、韓文、西班牙文、法文、義大利文、日文、葡萄牙文,現在希望能為更多的裝置提供 Assistant 服務。

▲Google Assistant 工程技術總監 Pra Gupta。(圖/記者洪聖壹攝)

而事實上除了Google Assistant,Google 雲端平台開發顧問 Kaz Sato 表示,Google 發展雲端應用超過 18 年,現在也已經全面導入 AI技術,現在已經可以有效地處理旗下與第三方合作廠商各項服務的後端處理,這包括影像分析、數據管理等等,有效提升企業運作效率。

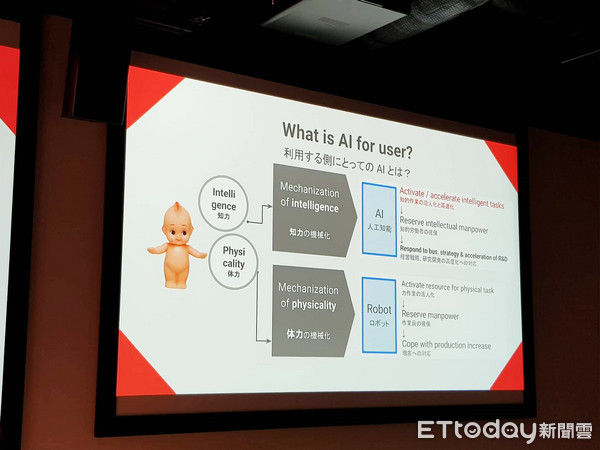

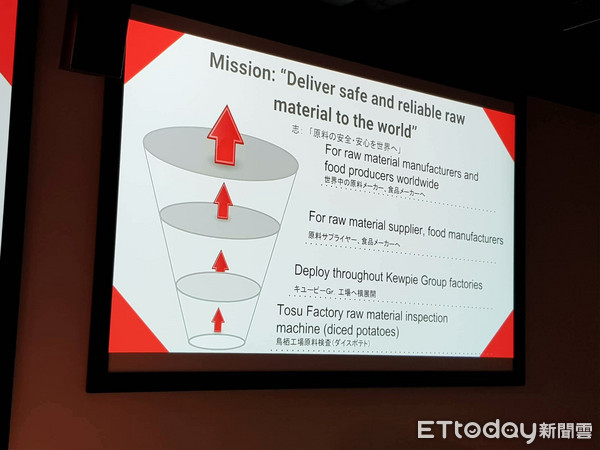

除了 Google 內部,這次也有第三方合作廠商導入人工智慧技術。像是創立於 1919 年的兒童食品公司Kewpie,本身雖然是一家傳統企業,但為了持續做出最安全、讓人安心的食品,卻導入最前端的人工智慧科技。Kewpie食品廠產品線負責人 Takeshi Ogino 表示,在日本因為當地需求,需要加速生產才能因應市場變化,因此該公司最後選擇導入人工智慧技術。

正所謂「好的產品從好的想法開始」,AI 提供許多很好的建議,好比說透過 AI 來協助檢驗哪些馬鈴薯是適合嬰兒食用,快速篩檢哪些條件的馬鈴薯是不適合食用的,初期食品廠在 2 個月內提供 AI 超過 100 萬顆馬鈴薯給它辨識,像是有些馬鈴薯已經變色了、代表不安全,藉此減少人工檢測上的負擔,現在生產線已經突破以往的生產效率。這是我們與 Google 合作的一個重大突破。

▲▼兒童食品公司Kewpie 導入人工智慧技術,透過機器學習的方式協助機器每天過濾上萬顆馬鈴薯顆粒,協助控管兒童食品安全。(圖/記者洪聖壹攝)

談到機器學習,Google 研究團隊產品經理、醫學博士彭浩怡(Lily Peng)再次說明了 Google 與印度當地醫療機構的合作,以及透過機器學習能夠快速篩檢出糖尿病視網膜病變,藉此知道哪些人是高風險的糖尿病患者。

*相關報導:「用機器學習辨識癌細胞與病變!Google:台灣有很強的先天優勢」

▲▼Google 研究團隊產品經理、醫學博士彭浩怡(Lily Peng)分享 Google 怎麼與第三方醫療機構協助貧苦人家進行診斷醫療。(圖/記者洪聖壹攝)

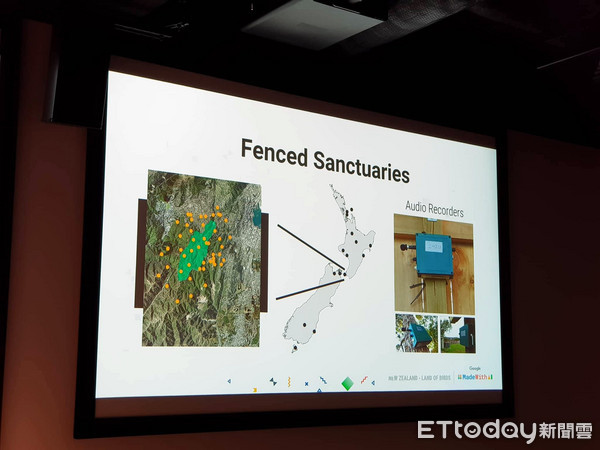

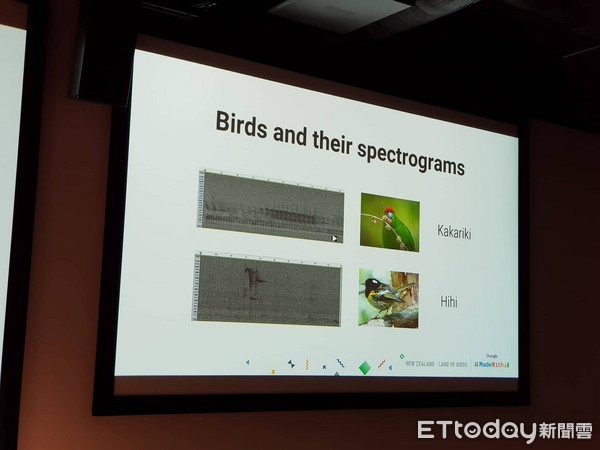

人工智慧應用也能應用在生態環境保護方面,紐西蘭威靈頓維多利亞大學博士 Victor Anton 分享他在威靈頓,透過多的設置錄音裝置(如黃色的點),錄製超過 15,000 小時的聲音資料,接著搭配機器學習的方式,然後整理資料、訓練 Tebsorflow、測試、分辨,讓機器可以明確分析出哪些鳥在什麼時候在哪些地方。

▲▼紐西蘭威靈頓維多利亞大學博士 Victor Anton 分享他在威靈頓,透過多的設置錄音裝置(如黃色的點),搭配機器學習的方式,分析鳥類習性。(圖/記者洪聖壹攝)

舉例來說,透過不斷的測試,團隊已經可以清楚了解 Kakariki、hihi 兩種不同的鳥叫聲,下一步,只要透過手機,就可以確認附近會有哪一種鳥。

Victor Anton 表示,目前團隊已經訓練三種鳥類模組,透過搜集影像跟相關資料了解動物行為,包括他們遷徙的狀況、獵食與被獵食的狀況,對於政府與保育團體來說,這類型的研究可說已經解決生態保育當中最大的難題,實際上當地政府也不斷透過提供資源跟技術,應用在生態保育。

不過畢竟導致鳥不在某個棲息地的變因很多,這包括鳥的棲息地、移動的位置,透過機器學習還沒有辦法一次性的解決所有人類對於動物生態的問題,目前還是需要透過專業研究、以實驗的方式搭配足夠量的數據,不過目前這些數據還未公開,主要的原因是整個研究還未結束,透過參數的調整,研究出一個模組之後,才會分享給更多保育團體參考。

Google 發展 AI 與機器學習的下一步

談到下一步,Google 這次談得相當深入,包括建構出更普及的機器學習 (Accessibility of building ML)訓練模組,這包括在教育領域幫助更多人建構自己的機器學習模型,內部也將持續透過機器學習速成課程,訓練更多Googler。外部將擴大影響範圍,募集更多學生與科學家參與培訓計畫,預計 2018 年初會把這個免費的線上課程開放給所有使用者。

Jeff Dean 也談到SketchRNN跟 Auto Mechine Learning,前者讓使用者和神經網路一起合作畫畫。使用者僅需畫一朵花就能讓系統自動完成畫作。後者透過建立一組作為控制組網路 (controller network) 的神經網路能夠推導出上千個子模型架構 (“child” model architecture),以找出執行效率最好的一個子模型架構。

而在未來,Google 希望能有效提升機器學習技術的精準與正確性,目前也開放讓公民大眾參與研究,為TensorFlow提供足夠的訓練資料並驗證分類的正確性。

再者透過遠端感測可以讓科學家更輕易的獲得大量數據資料,未來希望透過建立人工智慧開源的方式,讓生物學家可以利用機器學習歸納大量數據,其他時間就可以省下來做後續的結果判讀和歸納,進而更有效的保育鳥類。

相較於微軟亞洲研究院院長洪小文在 AI Day 當中宣布微軟投入人工智慧領域的六大承諾、三大研發面向、以及十二項產業應用情境,Google 研究團隊資深研究員 Jeff Dean 在這次的大會中揭示 Google 發展 AI 的三個發展方向,兩者其實都是殊途同歸,同樣著重攜手開發者導入自家人工智慧研究,不過微軟看起來比較朝向商務合作領域發展,而 Google 則是著重人本應用,從行動面下手。

至於人工智慧目前已經發展完全了嗎?其實才剛起步。Jeff Dean 表示,在理想的人工智慧之前,我們相信一切只是開端,並相信唯有讓人工智慧進入每個人的生活,才能發現與抓住它改善全人類生活的潛力和機會。

讀者迴響